Techopedia habla con Kevin Shamoun, vicepresidente senior (SVP) del proveedor de soluciones de pago Fortis y vicepresidente del Comité de IA de la Asociación de Transacciones Electrónicas, sobre el uso de la inteligencia artificial (IA) en el sector de los servicios financieros.

También profundizamos en la aparición de malos actores que utilizan la IA generativa para cometer fraudes, pero cómo puede utilizarse la IA para ayudar a predecir e identificar el fraude.

Sobre la IA Generativa en las Finanzas

P: ¿Cómo utilizan la IA las empresas del sector de los servicios financieros?

R: Ahora mismo no se utiliza principalmente la IA generativa, sino la tecnología que existe desde hace tiempo, como el aprendizaje automático: modelos que se entrenan en torno a las tolerancias de riesgo, etcétera.

En los servicios financieros, el uso de la IA generativa se va a centrar realmente en el aspecto del servicio: ¿qué podemos hacer para automatizar el chatbot? ¿Qué podemos hacer para automatizar las llamadas telefónicas? ¿Cuáles son las herramientas útiles para responder a las necesidades de servicio de la gente?

El reto de la IA en el sector financiero en el futuro es si se utiliza para intentar predecir cosas, como “¿qué va a pasar en el mercado de valores?

Si se trata de IA generativa, es una cosa, porque la gente siempre ha tenido sus modelos para intentar predecir el mercado de valores.

Pero los algoritmos piensan y procesan por sí mismos: ¿cómo toman las decisiones de comprar o vender algo? En el sector financiero, eso se convierte en una preocupación porque podría tener consecuencias financieras reales para una empresa.

¿Y si hace algo mal y tienes que volver atrás para inspeccionar lo que hizo? – ya es demasiado tarde.

Así que, entrenar ese tipo de modelos generativos de IA que intentan pensar por sí mismos y ser predictivos, no lo verás hasta dentro de bastante tiempo. No creo que la gente esté dispuesta a poner en juego su propio dinero como prueba. La recompensa no está ahí.

P: ¿Hay alguna forma de evitar el sesgo de los algoritmos de IA en la toma de decisiones financieras?

R: Podrías intentarlo, pero es inevitable. La IA va a empezar a elaborar sus propias opiniones basándose en los conjuntos de datos que se le proporcionen. Los humanos tenemos prejuicios: tanto si dices que eres imparcial como si no, eso no existe.

Nuestras percepciones son la realidad, así que las reglas que intentas aplicar a la IA son injustas.

Si te fijas en lo que hacen los humanos, ¿cómo esperas que algo sea perfecto? ¿Y cuál es la definición de perfecto? Porque mi definición de parcialidad es diferente de tu definición.

No es justo decir que una IA generativa puede ser imparcial, porque no es tan blanco o negro.

Sobre la IA y el fraude financiero

P: ¿Cómo puede utilizarse la IA para detectar fraudes y actividades ilegales?

R: Actualmente se utiliza mucha IA, por ejemplo, en el procesamiento de transacciones. Tanto desde el punto de vista de la emisión de tarjetas como desde el espacio de los pagos, se está haciendo un gran trabajo con la utilización de la tecnología de IA para prevenir y proteger del fraude incluso antes de que se ejecute la transacción: tecnología como 3D Secure 2 lleva poco tiempo en el mercado.

Hay más de 200 puntos de datos que se agregan desde el dispositivo del consumidor cuando realiza una transacción, que se envían al emisor para ver si éste conoce el dispositivo. Ahora estamos en un mundo impulsado por los datos, y se agregan tantos que es bastante asombroso.

P: ¿Existe el riesgo de que el uso de aplicaciones y herramientas de IA provoque más fraude?

R: Desde el punto de vista de los malos actores, siempre lo están intentando. Ese es el juego: los buenos contra los malos.

En la IA generativa tienes ChatGPT, y luego a los malos se les ocurren nombres creativos como ChaosGPT y FraudGPT; son los malhechores intentando causar estragos, y será esta lucha continua.

Ha sido así desde el principio de la tecnología, la gente busca formas de -ni siquiera hackear realmente- sino de saltarse un poco las normas. Ahí es donde está probablemente la mayor amenaza: los tipos que se saltan la línea entre lo que está permitido hacer y lo que no.

Se pasan un poco de la raya de lo que no está permitido hacer, y así tienen ventaja sobre los que intentan hacer lo correcto.

P: ¿Está preparado el sector de los servicios financieros para hacer frente a las posibilidades de la IA?

R: Creo que sí. No es algo nuevo; simplemente es diferente. Alguien saca un arma nueva, así que se trata de: cómo te defiendes contra el arma, ¿necesitas un escudo nuevo?

Los vectores de ataque no han cambiado. En un mundo basado en API, lo sactores maliciosos, incluso con IA, siguen intentando manipular las mismas API. Sólo tienen una herramienta diferente en el cinturón de herramientas para intentar atacar mejor, más rápido, más fácilmente.

Se trata de mantenerse en el lado de la defensa para decir: ¿tenemos todo bloqueado – hay alguna ventana abierta en alguna parte que no debería estarlo? ¿Hay alguna que un robot de IA pueda encontrar que los hackers tradicionales no hayan encontrado o no hayan visto antes?

La gran amenaza son los atacantes que tienen la capacidad de automatizar con IA y ser dinámicos en sus ataques, y no hace falta una persona para codificarlo. Pueden ir y actualizar sus ataques porque eso es lo que le has dicho a la IA que haga, y va a ejecutar el plan.

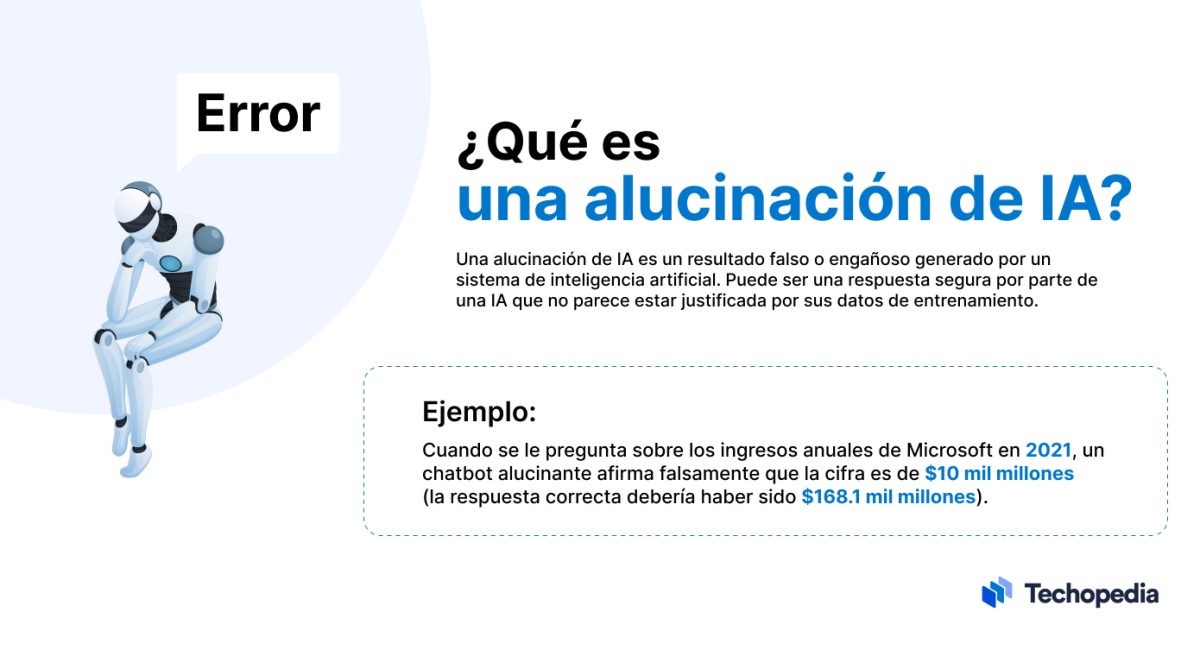

La IA siempre piensa que tiene razón, así que si le das una instrucción y le preguntas: “¿es esto correcto?”, por supuesto, va a decir que sí porque te acaba de dar la respuesta, aunque esté completamente equivocada y sea delirante.

Evidentemente, ése es el riesgo de confiar demasiado en él, se inventa cosas para decirte que suenan muy correctas. Es interesante que el término que han acuñado para ello sea “alucinación”.

Por qué los humanos son la primera línea en ciberseguridad

P: ¿Es necesario que las organizaciones adopten un enfoque diferente de la ciberseguridad?

R: Se trata de educación. Al fin y al cabo, si estás hablando de seguridad, la mayor debilidad somos nosotros como personas.

Así que se trata simplemente de mantener a la gente informada de lo que debe tener en cuenta y de las estafas que hay ahí fuera, y luego la responsabilidad recae en los fabricantes de dispositivos.

Si pueden proporcionar un dispositivo que no se pueda penetrar fácilmente, entonces el resto de la responsabilidad recae en los consumidores, desde un punto de vista empresarial o personal, simplemente para asegurarse de que estás educado para no hacer clic en el enlace que no conoces.

Tu director general no te va a pedir tarjetas regalo a través de mensajes de texto -suena gracioso, pero oigo estas historias todo el tiempo, y sigue reduciéndose al factor humano-, ahí es donde se producen la mayoría de las violaciones.

Si te fijas en la mayoría de las violaciones de las que estamos hablando en los últimos años, todas empezaron con una persona. La última, con MGM cerrada durante tanto tiempo, se redujo a que alguien suplantó a otra persona en una llamada telefónica para obtener acceso. No entraron por la fuerza, no forzaron la puerta principal, forzaron la cerradura.

Todo se reduce a la conciencia del consumidor, y es difícil discernir lo que es cierto hoy en día. Las plataformas de medios sociales están haciendo un mejor trabajo, pero es una lucha que nunca acabará.

El panorama normativo

P: ¿Qué opinas del entorno normativo, a la luz de la reciente publicación por la Casa Blanca de una Orden Ejecutiva sobre la gestión de los riesgos de la IA?

R: Ya era hora, creo que vamos retrasados. La realidad es que el resto del mundo, concretamente la UE, está mucho más adelantado que nosotros desde el punto de vista de la regulación, así que será interesante ver cómo Estados Unidos empieza a abordar estas cuestiones.

Es muy difícil regular algo como la IA. Esperemos que el gobierno pueda idear un marco que sea fluido, pero si la historia tiende a repetirse, no va a ser así. Al igual que todo lo demás en tecnología, siempre parece ir por detrás.

El equilibrio es realmente difícil de alcanzar. Si te fijas en las regulaciones anteriores -utilizaré la criptomoneda como ejemplo-, el gobierno tardó en regular, y por fin se está poniendo al día con el lado CBDC de las cosas.

El gobierno tiene que establecer un marco que permita a alguien ser flexible. Y si pones las barandillas en torno a los principios de lo que va a ocurrir en la IA, lo que puedes y no puedes hacer, en realidad se trata de seguir unos principios.

Así que si consigues establecer los principios básicos adecuados, creo que todo irá bien.

Las startups que tendrían dudas son probablemente las que tú quieres que tengan dudas.

Creo que hay un lugar para la regulación en cosas como la IA, porque algo que piensa por sí mismo puede tener un gran impacto real; da bastante miedo.

Tendencias de la IA en 2024

P: ¿Cuáles son las principales tendencias de la IA en 2024?

R: Van a girar en torno a lo que se nos permite hacer con la IA generativa. ¿Está permitido utilizar la IA generativa en algo que no se limita a que yo pueda hablar con ella en mi ordenador, sino que realmente puede actuar?

Ahí es donde probablemente se necesite la mayor regulación desde el punto de vista de la supervisión gubernamental, porque entonces se convierte en algo real.

Tomando el ejemplo de iRobot, pones IA generativa dentro de algún tipo de robot que ahora va más allá de su programación de simplemente andar por ahí o hacer una función específica: puede hacer algo o tomar una decisión por sí mismo, y cuando le preguntas por qué lo ha hecho, dice igual que un humano: “No lo sé, simplemente lo he hecho, no sé por qué”.

Es entonces cuando se vuelve real, y creo que empezaremos a ver algo de eso el año que viene.

Desgraciadamente, creo que lo que ocurrirá es que alguien saldrá herido y se producirá una enorme protesta pública al respecto -con razón- y entonces es cuando se hará realmente real para la gente.

Todas estas empresas emergentes, su respuesta será: “Uy, se suponía que no tenía que hacer eso”. Bueno… no debía hacerlo, pero lo hizo de todos modos, así que ¿qué controles teníamos? ¿Y cómo evitas que anule las comprobaciones que has hecho?

Porque al principio con ChatGPT podías incitarlo y manipularlo para obtener respuestas que probablemente no deberían haberse dado en primer lugar.

De nuevo, la gente está más o menos en la línea de lo que se supone que debes hacer con ella, e intentan seguir pinchando.

La gente piensa que la IA va a revolucionar distintos sectores, y creo que tienen razón en algunos aspectos. Pero probablemente no será tan amplio como piensan. Cuando piensan en la gente del sector servicios y suponen que la IA va a ocupar todos esos puestos de trabajo, en realidad no creo que vaya a ser así.

Utilizaré una analogía de cuando había mucha gente cortando la hierba a mano, y entonces alguien inventó un cortacésped. Lo revolucionó, y lo que acabó ocurriendo es que en realidad creó la posibilidad de más empleos porque es muy fácil ir a limpiar un campo para hacer algo diferente en él; ahora puedo ir a practicar un deporte fácilmente.

Así que ahora necesitamos gente que vaya a practicar el deporte, ahora puedo poner un estadio aquí. De lo que no se da cuenta la gente es de que, si bien va a sustituir a todos estos trabajos, son los trabajos que la gente probablemente no quiere de todos modos, que es por lo que estamos trabajando para sustituirlos, y entonces va a abrir oportunidades diferentes, va a ser un cambio de paradigma para dónde se necesita a la gente.

Cuando dices que la IA va a sustituir puestos de trabajo, si ahora no podemos encontrar personas para esos puestos, ¿realmente van a ocupar todos esos puestos de trabajo que tenemos vacantes de todos modos? Mi perspectiva es que va a nivelar a la gente más que a ocupar sus puestos de trabajo.

Acerca de Kevin Shamoun

Kevin Shamoun es Vicepresidente Senior (SVP) de FortisPay (Fortis Payment Systems).

Anteriormente fue fundador de Zeamster, que adquirió Fortis.

Kevin tiene amplios conocimientos operativos y técnicos del sector de los pagos, incluidos casi 20 años de experiencia trabajando con importantes Organizaciones de Servicios Independientes (ISO) e importantes Instituciones Financieras.

Ha gestionado todos los aspectos del sector de los pagos, tanto de adquisición como de emisión.

Ha sido responsable del diseño, despliegue, mantenimiento y seguridad de sistemas críticos que daban soporte a múltiples organizaciones.

Actualmente es Vicepresidente del Comité de Tecnología de la Asociación de Transacciones Electrónicas (ETA) y tiene una licenciatura en Ciencias por la Universidad de Oakland y un máster en Tecnología de la Información Empresarial por el Walsh College.